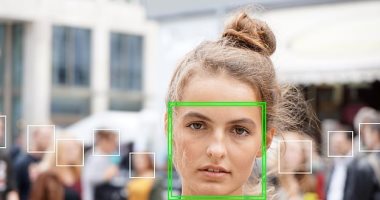

تدعو مجموعة من الخبراء تضم أكثر من 1000 باحث وأكاديمي إلى إعادة النظر في نشر دراسة مقبلة على الشبكات العصبية التي تدعي توقع الإجرام، وفي رسالة مفتوحة نُشرت هذا الأسبوع، حذرت المجموعة التي تتكون من خبراء في مجال الإحصاء والتعلم الآلي والذكاء الاصطناعي والقانون وعلم الاجتماع والتاريخ ودراسات الاتصال والأنثروبولوجيا، سبرينجر، ناشر مجلة Nature العلمية، من نشر الدراسة في سلسلة كتاب قادمة.

وفقا لما ذكرته صحيفة "ديلى ميل" البريطانية، تدعي الدراسة نفسها أنه يمكن استخدام برنامج التعرف الآلي على الوجه كأداة لإنفاذ القانون التي يمكنها تحديد المجرمين قبل ارتكاب الجرائم.

وقال الباحث المشارك للدراسة وأستاذة جامعة هاريسبيرج روزبه ساديجيان في بيان: "نعلم بالفعل أن تقنيات التعلم الآلي يمكن أن تتفوق على البشر في مجموعة متنوعة من المهام المتعلقة بالتعرف على الوجه واكتشاف العواطف".

وأضاف الباحث: "يشير هذا البحث إلى مدى قوة هذه الأدوات من خلال إظهار أنها يمكن أن تستخرج ميزات دقيقة في صورة تننبأ بشدة بالإجرام."

ولعل من بين المخاوف التي تم تناولها في الرسالة ضد هذه الدراسة، هي أن الأدلة العلمية والبحوث والأساليب غير السليمة المستخدمة لدعم استخدام الشرطة التنبؤية.

كما تشير الرسالة إلى عدم القدرة الدقيقة لتقنية التعرف على الوجه لتحديد الأشخاص ذوى البشرة الداكنة، الذين يقولون إنهم قد يؤثرون بشكل غير متناسب على المجتمعات السوداء.

أجرى اختبار من جانب اتحاد الحريات المدنية الأمريكية لبرمجيات التعرف على الوجه من أمازون في عام 2018، يسمى Rekognition ، وتبين التحيز ضد اللون الأسمر.

وأكدت رسالة الخبراء بحظر النشر: "لنكن واضحين.. لا توجد طريقة لتطوير نظام يمكنه التنبؤ أو تحديد الإجرام غير المتحيز عنصريًا، لأن فئة الإجرام نفسها متحيزة عنصريًا".